今日觀點!如何應對生成式大模型「雙刃劍」?之江實驗室發布《生成式大模型安全與隱私白皮書》

機器之心發布

作者:之江實驗室

當前,生成式大模型已經為學術研究甚至是社會生活帶來了深刻的變革,以 ChatGPT 為代表,生成式大模型的能力已經顯示了邁向通用人工智能的可能性。但同時,研究者們也開始意識到 ChatGPT 等生成式大模型面臨著數據和模型方面的安全隱患。

【資料圖】

【資料圖】

今年 5 月初,美國白宮與谷歌、微軟、OpenAI、Anthropic 等 AI 公司的 CEO 們召開集體會議,針對 AI 生成技術的爆發,討論技術背后隱藏的風險、如何負責任地開發人工智能系統,以及制定有效的監管措施。國內的生成式大模型技術也正在發展之中,但是同時也需要先對安全問題進行相應的分析以便雙管齊下,避免生成式大模型這把雙刃劍帶來的隱藏危害。

為此,之江實驗室基礎理論研究院人工智能與安全團隊首次全面總結了 ChatGPT 為代表的生成式大模型的安全與隱私問題白皮書,希望能夠為從事安全問題研究的技術人員指明方向,同時也為 AI 相關政策的制定者提供依據。

白皮書鏈接: https://github.com/xiaogang00/white-paper-for-large-model-security-and-privacy生成式大模型的發展與重要應用

這份白皮書首先總結了 ChatGPT 與 GPT4 等生成式大模型的發展歷程,以及其帶來的各種令人驚嘆的能力和社會變革、社會應用等。作者列舉了 ChatGPT 和 GPT4 出現之前的 GPT-1、GPT-2、GPT-3、Google Bert 等模型的特點以及缺點,這些缺點與 ChatGPT 和 GPT4 的強大能力形成了對比;并且,ChatGPT 和 GPT4 之后又涌現了一大批的模型,包括 LLaMa、Alpaca、文心一言、通義千問等,它們的出現使得在人機交互、資源管理、科學研究、內容創作等應用領域出現了新的、強有力的工具。但同時也出現了包括數據安全,使用規范、可信倫理、知識產權以及模型安全方面的問題。

數據安全問題

白皮書提出,數據的安全和隱私是 ChatGPT 及 GPT4 等生成式大模型使用和研發過程中一個極為重要的問題,并從「顯式」和「隱式」兩個方面對其進行了分析。

在顯式的信息泄漏中,首先,ChatGPT 等生成式大模型的訓練數據在不經意間被轉換成了生成內容,其中就包括了敏感和隱私的個人信息如銀行卡賬號、病例信息等。此外,ChatGPT 的數據安全和隱私隱患還體現在它對于對話框內容的存儲,當用戶在和 ChatGPT 互動時,他們的信息會以某些形式被記錄和存儲下來。

白皮書還提出了之前被大家忽略的隱式信息泄漏問題。首先,ChatGPT 體現出的數據安全和隱私的隱患是它可能通過對對話框數據的收集進行廣告推薦,以及收集對話框數據進行推薦或者其他的下游機器學習任務,且 ChatGPT 有時候可能也會生成虛假的信息,以此來誘導用戶泄漏一系列的數據。

使用規范問題

在白皮書中,作者提到 ChatGPT 和 GPT4 等生成式大模型強大的理解和生成能力雖然為我們的生活和生產帶來了很多的便利,但是同時也存在更多的機會被惡意使用。在沒有規范約束的情況下,惡意使用將帶來很多的社會性問題。

其一,ChatGPT 和 GPT-4 等模型的強大能力使得某些別有用心的人想要將其作為違法活動的工具。例如用戶可以利用 ChatGPT 來編寫詐騙短信和釣魚郵件,甚至開發代碼,按需生成惡意軟件和勒索軟件等,而無需任何編碼知識和犯罪經驗。

其二,ChatGPT 和 GPT4 等生成式大模型沒有把不同地區的法律規范考慮在內,在使用和輸出的過程中可能會違反當地法律法規,因此需要一個強而有力的當地監管系統來檢測其使用是否與當地法律法規相沖突。

其三,對于一些游離于安全和危險之間的灰色地帶,ChatGPT 等生成式大模型的安全能力還沒有得到增強。例如 ChatGPT 可能會輸出一些誘導性的語句,包括跟抑郁癥患者溝通時候可能會輸出某些語句導致其產生輕生的心態。

可信倫理問題

ChatGPT 等生成式大模型以問答形態存在于社會層面,但其回復往往存在不可信,或者無法判斷其正確的問題,會有似是而非的錯誤答案,甚至對現有社會倫理產生沖擊。

白皮書指出,首先 ChatGPT 等生成式大模型的回復可能是在一本正經地胡說八道,語句通暢貌似合理,但其實完全大相徑庭,目前模型還不能提供合理的證據進行可信性的驗證。例如,ChatGPT 可能會對一些歷史、科學、文化等方面的問題回答錯誤或者與事實相悖,甚至可能會造成誤導或者誤解,需要用戶有自己的鑒別能力。

ChatGPT 等生成式大模型的倫理問題也在白皮書中被詳細討論。即使 OpenAI 等研發機構已經使用 ChatGPT 本身生成了他們的道德準則,但其中的道德準則是否符合我國國情的基本價值觀原則,尚未有定論。作者提出其中存在傳播有害意識形態、傳播偏見和仇恨、影響政治正確、破壞教育公平、影響國際社會公平、加劇機器取代人類的進程、形成信息繭房阻礙正確價值觀形成等問題。

知識產權問題

ChatGPT 等生成式大模型憑借強大的語言處理能力和低廉使用成本給社會方方面面帶來便利的同時,也存在侵權的問題,對現存版權法體系帶來沖擊。例如 ChatGPT 生成的作品可能存在著作權爭議:ChatGPT 雖然有著出色的語言處理能力,但是即使生成的作品符合知識產權的全部形式要求,ChatGPT 也無法成為著作權的主體,這是因為著作權主體享有權利的同時也要承擔對應的社會責任,而 ChatGPT 只能作為用戶強大的輔助生產力工具,它無法自主創作,更不要談享有權利、履行義務的主體要求。

而且 ChatGPT 等生成式大模型仍無法獨立創作,更沒有自主思維和獨立思考的能力,因而,ChatGPT 根據用戶的輸入生成的內容不符合作品「獨創性」的要求。ChatGPT 用于模型訓練的數據來自于互聯網,不論多么高級的模型訓練算法必然涉及到對現有智力成果的引用、分析、處理等,必然存在對他人合法知識產權的侵犯問題。

模型安全問題

從攻防技術角度來看,ChatGPT 等生成式大模型也存在著模型安全的問題。ChatGPT 本質上是基于深度學習的一個大型生成模型,也面臨著人工智能安全方面的諸多威脅,包括模型竊取以及各種攻擊引起輸出的錯誤(例如包括對抗攻擊、后門攻擊、prompt 攻擊、數據投毒等)。

例如,模型竊取指的是攻擊者依靠有限次數的模型詢問,從而得到一個和目標模型的功能和效果一致的本地模型。而 ChatGPT 已經開放了 API 的使用,這更為模型竊取提供了詢問入口。又比如,ChatGPT 和 GPT4 作為一個分布式計算的系統,需要處理來自各方的輸入數據,并且經過權威機構驗證,這些數據將會被持續用于訓練。那么 ChatGPT 和 GPT4 也面臨著更大的數據投毒風險。攻擊者可以在與 ChatGPT 和 GPT4 交互的時候,強行給 ChatGPT 和 GPT4 灌輸錯誤的數據,或者是通過用戶反饋的形式去給 ChatGPT 和 GPT4 進行錯誤的反饋,從而降低 ChatGPT 和 GPT4 的能力,或者給其加入特殊的后門攻擊。

安全與隱私建議

最后,白皮書中對于安全和隱私等問題都進行了相應的建議,可作為之后技術研究者們的方向和政策制定者們的參考依據。

在保護隱私建議方面,白皮書提出要在增強原始數據中高敏感隱私信息的辨別和傳播限制;在數據收集過程中利用差分隱私等技術進行隱私保護;對于訓練數據的存儲進行數據加密形式的安全保護;在模型訓練過程中使用安全多方計算,同態加密以及聯邦學習等技術進行數據隱私和安全保護;建立數據隱私評估和模型保護與安全認證體系,并且保護下游應用的隱私。

在模型安全問題的建議上,白皮書提出對安全與隱私信息的檢測模型的訓練;讓不同的模型適用于不同國家的法律條款;以及針對各種對抗攻擊進行防御性訓練。

在模型合規問題上,白皮書提出進行可信輸出的度量,信任值評價,增加模型輸出的版權信息的查詢功能。

總結來說,AI 生成式大模型的發展離不開安全,因此其安全問題將作為下一個技術點,值得眾多研究者去攻克。而安全也是社會穩定的保障,有關部門需要盡快進行政策的制定。

THE END

轉載請聯系本公眾號獲得授權

投稿或尋求報道:content@jiqizhixin.com

關鍵詞:

-

2023年愛心售報|小報童帶病堅持來賣報 孩子成長迅速讓家長很欣慰 揚子晚報7月7日訊(記者季宇軒實習生王元釗)7月6日是2023年揚子晚報暑

2023年愛心售報|小報童帶病堅持來賣報 孩子成長迅速讓家長很欣慰 揚子晚報7月7日訊(記者季宇軒實習生王元釗)7月6日是2023年揚子晚報暑 -

我國人工智能蓬勃發展 核心產業規模達5000億元 7月6日,2023世界人工智能大會在上海世博中心拉開帷幕。圖為參觀者在達

我國人工智能蓬勃發展 核心產業規模達5000億元 7月6日,2023世界人工智能大會在上海世博中心拉開帷幕。圖為參觀者在達 -

應對強降雨 嶗山巴士突擊隊24小時備戰 近日,島城迎來強降雨天氣。為保證所屬公交線路安全運行,青島城運控股

應對強降雨 嶗山巴士突擊隊24小時備戰 近日,島城迎來強降雨天氣。為保證所屬公交線路安全運行,青島城運控股 -

齊車公司為新西蘭“量身定制”鐵路貨車 中新網齊齊哈爾7月7日電 (劉廷祿)7月7日,由中車齊車集團齊車公司

齊車公司為新西蘭“量身定制”鐵路貨車 中新網齊齊哈爾7月7日電 (劉廷祿)7月7日,由中車齊車集團齊車公司 -

什么是edn EDN是一種數據交換標準格式(ESDF),它是一種在電子設計領域中廣泛使

什么是edn EDN是一種數據交換標準格式(ESDF),它是一種在電子設計領域中廣泛使 -

教育部部署做好2023年中小學暑期安全工作 暑假即將來臨,為使廣大中小學生度過一個平安快樂的假期,日前,教育部

教育部部署做好2023年中小學暑期安全工作 暑假即將來臨,為使廣大中小學生度過一個平安快樂的假期,日前,教育部

-

云南建投混凝土(01847)附屬高分子公司訂立保理協議 智通財經APP訊,云南建投混凝土(01847)發布公告,于2023年7月7日,該公

云南建投混凝土(01847)附屬高分子公司訂立保理協議 智通財經APP訊,云南建投混凝土(01847)發布公告,于2023年7月7日,該公 -

明源云(00909.HK)委任梁瑞冰為聯席公司秘書 格隆匯7月7日丨明源云(00909 HK)宣布,司徒嘉怡因其他工作安排,已提呈

明源云(00909.HK)委任梁瑞冰為聯席公司秘書 格隆匯7月7日丨明源云(00909 HK)宣布,司徒嘉怡因其他工作安排,已提呈 -

彩客新能源(01986)4月21日斥資8.58萬港元回購6.2萬股 智通財經APP訊,彩客新能源(01986)發布公告,于2023年4月21日,該公司

彩客新能源(01986)4月21日斥資8.58萬港元回購6.2萬股 智通財經APP訊,彩客新能源(01986)發布公告,于2023年4月21日,該公司 -

富祥藥業:7月6日接受機構調研,包括知名機構盤京投資的多家機構參與 2023年7月7日富祥藥業(300497)發布公告稱公司于2023年7月6日接受機構

富祥藥業:7月6日接受機構調研,包括知名機構盤京投資的多家機構參與 2023年7月7日富祥藥業(300497)發布公告稱公司于2023年7月6日接受機構 -

廣東宏大:預計2023年1-6月盈利,凈利潤同比增20%至30% 廣東宏大發布業績預告,預計2023年1-6月歸屬凈利潤盈利3 02億元至3 27

廣東宏大:預計2023年1-6月盈利,凈利潤同比增20%至30% 廣東宏大發布業績預告,預計2023年1-6月歸屬凈利潤盈利3 02億元至3 27 -

馮奎章_馮奎 1、馮奎賣妻是明朝末年的故事。2、《馮奎賣妻》保定府有一對夫妻叫馮奎

馮奎章_馮奎 1、馮奎賣妻是明朝末年的故事。2、《馮奎賣妻》保定府有一對夫妻叫馮奎 -

注意!家里這些物品也要“防暑降溫” 入夏以來,多輪高溫天氣來襲用電需求量較常年同期偏高面對“烤”驗日常

注意!家里這些物品也要“防暑降溫” 入夏以來,多輪高溫天氣來襲用電需求量較常年同期偏高面對“烤”驗日常 -

2023年愛心售報|小報童帶病堅持來賣報 孩子成長迅速讓家長很欣慰 揚子晚報7月7日訊(記者季宇軒實習生王元釗)7月6日是2023年揚子晚報暑

2023年愛心售報|小報童帶病堅持來賣報 孩子成長迅速讓家長很欣慰 揚子晚報7月7日訊(記者季宇軒實習生王元釗)7月6日是2023年揚子晚報暑 -

粵電力A最新公告:預計上半年凈利潤8億元-9.5億元 同比扭虧為盈 粵電力A公告預計上半年凈利潤8億元95億元去年同期虧損1372億元同比扭虧

粵電力A最新公告:預計上半年凈利潤8億元-9.5億元 同比扭虧為盈 粵電力A公告預計上半年凈利潤8億元95億元去年同期虧損1372億元同比扭虧 -

潼關黃金(00340.HK)擬3.39億港元收購宏勇投資100%股份 格隆匯7月7日丨潼關黃金(00340 HK)公告,于2023年7月7日,公司(作為買

潼關黃金(00340.HK)擬3.39億港元收購宏勇投資100%股份 格隆匯7月7日丨潼關黃金(00340 HK)公告,于2023年7月7日,公司(作為買 -

小摩:轉型和AI利好被負面因素抵消 首予IBM(IBM.US)“中性”評級 摩根大通分析師BrianEssex發表研報,首次覆蓋IBM(IBM US),給予“中性

小摩:轉型和AI利好被負面因素抵消 首予IBM(IBM.US)“中性”評級 摩根大通分析師BrianEssex發表研報,首次覆蓋IBM(IBM US),給予“中性 -

Wolfe下修派拉蒙環球(PARA.US)業績預期 降評級至“跑輸大盤” WolfeResearch將派拉蒙環球(PARA US)的評級從“與同行評級”下調為“跑

Wolfe下修派拉蒙環球(PARA.US)業績預期 降評級至“跑輸大盤” WolfeResearch將派拉蒙環球(PARA US)的評級從“與同行評級”下調為“跑 -

順豐控股最新公告:4月速運物流業務營業收入146.46億元 同比增長27.29% 順豐控股公告,4月速運物流業務營業收入146 46億元,同比增長27 29%;

順豐控股最新公告:4月速運物流業務營業收入146.46億元 同比增長27.29% 順豐控股公告,4月速運物流業務營業收入146 46億元,同比增長27 29%; -

青島銀行(03866.HK):提名陳霜及杜寧為董事候選人 格隆匯7月7日丨青島銀行(002948)(03866 HK)公布,董事會于2023年7月7日

青島銀行(03866.HK):提名陳霜及杜寧為董事候選人 格隆匯7月7日丨青島銀行(002948)(03866 HK)公布,董事會于2023年7月7日 -

深圳大動作!24條舉措 劍指… 作為全國外貿重鎮,深圳在促進外貿穩定健康發展上再加碼!日前,中國人

深圳大動作!24條舉措 劍指… 作為全國外貿重鎮,深圳在促進外貿穩定健康發展上再加碼!日前,中國人 -

我國人工智能蓬勃發展 核心產業規模達5000億元 7月6日,2023世界人工智能大會在上海世博中心拉開帷幕。圖為參觀者在達

我國人工智能蓬勃發展 核心產業規模達5000億元 7月6日,2023世界人工智能大會在上海世博中心拉開帷幕。圖為參觀者在達 -

李玟媽媽首度發聲,公開吐槽外國女婿缺點,李玟曾為老公整晚痛哭 閱讀此文前,誠邀您點擊一下“關注”,方便您隨時查閱一系列優質文章,

李玟媽媽首度發聲,公開吐槽外國女婿缺點,李玟曾為老公整晚痛哭 閱讀此文前,誠邀您點擊一下“關注”,方便您隨時查閱一系列優質文章, -

中國銀河(06881)因可轉債轉股2022年末期股息調整為每股0.22533元 智通財經APP訊,中國銀河(601881)(06881)公布,由于公司于2022年3月24

中國銀河(06881)因可轉債轉股2022年末期股息調整為每股0.22533元 智通財經APP訊,中國銀河(601881)(06881)公布,由于公司于2022年3月24 -

正業科技(300410.SZ)選舉余笑兵為董事長 智通財經APP訊,正業科技(300410)(300410 SZ)公告,公司董事會同意選舉

正業科技(300410.SZ)選舉余笑兵為董事長 智通財經APP訊,正業科技(300410)(300410 SZ)公告,公司董事會同意選舉 -

紫金礦業(02899.HK)預計上半年凈利約102億元 同比下降19.2% 格隆匯7月7日丨紫金礦業(02899 HK)公告,公司預計2023年半年度實現歸屬

紫金礦業(02899.HK)預計上半年凈利約102億元 同比下降19.2% 格隆匯7月7日丨紫金礦業(02899 HK)公告,公司預計2023年半年度實現歸屬 -

中航光電(002179.SZ):擬投資27.2億元在洛陽購置土地建高端互連科技產業社區項目 格隆匯7月7日丨中航光電(002179)(002179 SZ)公布,2023年7月7日,公司

中航光電(002179.SZ):擬投資27.2億元在洛陽購置土地建高端互連科技產業社區項目 格隆匯7月7日丨中航光電(002179)(002179 SZ)公布,2023年7月7日,公司 -

建發國際集團(01908.HK)根據以股代息計劃發行1.08億股 格隆匯7月7日丨建發國際集團(01908 HK)公布,根據公司以股代息計劃而于

建發國際集團(01908.HK)根據以股代息計劃發行1.08億股 格隆匯7月7日丨建發國際集團(01908 HK)公布,根據公司以股代息計劃而于 -

“推特殺手”一天拿下3000萬用戶!馬斯克或怒告扎克伯格 中新網7月7日電日前,Meta首席執行官扎克伯格收到了一封“警告信”——

“推特殺手”一天拿下3000萬用戶!馬斯克或怒告扎克伯格 中新網7月7日電日前,Meta首席執行官扎克伯格收到了一封“警告信”—— -

應對強降雨 嶗山巴士突擊隊24小時備戰 近日,島城迎來強降雨天氣。為保證所屬公交線路安全運行,青島城運控股

應對強降雨 嶗山巴士突擊隊24小時備戰 近日,島城迎來強降雨天氣。為保證所屬公交線路安全運行,青島城運控股 -

海口迎來暑期學車潮 這樣做可以避免學車“坑” 原標題:海口迎來暑期學車潮這樣做可以避免學車“坑”新海南客戶端、南

海口迎來暑期學車潮 這樣做可以避免學車“坑” 原標題:海口迎來暑期學車潮這樣做可以避免學車“坑”新海南客戶端、南 -

高端降價,中低端發力!AMD新品還能觸底反彈嗎? 2022年9月15日,是一個所有電腦DIY玩家都會銘記的日子。ETH順利合并,

高端降價,中低端發力!AMD新品還能觸底反彈嗎? 2022年9月15日,是一個所有電腦DIY玩家都會銘記的日子。ETH順利合并, -

齊車公司為新西蘭“量身定制”鐵路貨車 中新網齊齊哈爾7月7日電 (劉廷祿)7月7日,由中車齊車集團齊車公司

齊車公司為新西蘭“量身定制”鐵路貨車 中新網齊齊哈爾7月7日電 (劉廷祿)7月7日,由中車齊車集團齊車公司 -

廣匯物流最新公告:擬定增募資不超過18億元 控股股東參與認購 廣匯物流公告,擬定增募資不超過18億元,用于寧東煤炭儲運基地項目(含

廣匯物流最新公告:擬定增募資不超過18億元 控股股東參與認購 廣匯物流公告,擬定增募資不超過18億元,用于寧東煤炭儲運基地項目(含 -

利歐股份(002131.SZ):部分董事、高管擬合計減持不超616.7萬股 格隆匯7月7日丨利歐股份(002131)(002131 SZ)公布,公司于2023年7月7日

利歐股份(002131.SZ):部分董事、高管擬合計減持不超616.7萬股 格隆匯7月7日丨利歐股份(002131)(002131 SZ)公布,公司于2023年7月7日 -

湖北能源(000883.SZ):6月完成發電量36.14億千瓦時,同比增長12.83% 格隆匯7月7日丨湖北能源(000883)(000883 SZ)公布,2023年6月,公司完成

湖北能源(000883.SZ):6月完成發電量36.14億千瓦時,同比增長12.83% 格隆匯7月7日丨湖北能源(000883)(000883 SZ)公布,2023年6月,公司完成

熱門資訊

-

源自福特超級平臺,江鈴福特新款輕客來襲 說起輕客,大家的第一印象總是全順...

源自福特超級平臺,江鈴福特新款輕客來襲 說起輕客,大家的第一印象總是全順... -

多彩新媒協同多省IPTV加速布局大屏生態圈,“看中國”深度挖掘 智能大屏價值 6月16日,在北京論道暨第25屆中國...

多彩新媒協同多省IPTV加速布局大屏生態圈,“看中國”深度挖掘 智能大屏價值 6月16日,在北京論道暨第25屆中國... -

出擊!招行信用卡協助警方重拳打擊金融“黑灰產”! 在上海浦東新區某大廈內,掛著“法...

出擊!招行信用卡協助警方重拳打擊金融“黑灰產”! 在上海浦東新區某大廈內,掛著“法... -

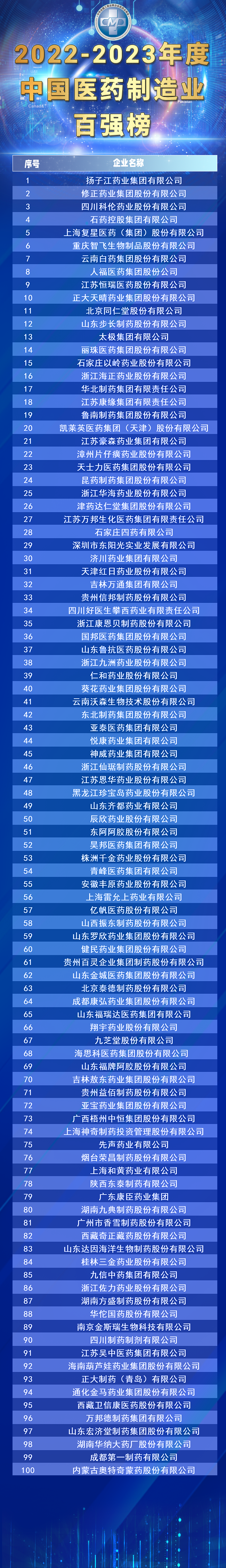

“2022-2023年度中國醫藥制造業百強”出爐,揚子江藥業集團榮登榜首 7月4日,由全國工商聯醫藥業商會、...

“2022-2023年度中國醫藥制造業百強”出爐,揚子江藥業集團榮登榜首 7月4日,由全國工商聯醫藥業商會、...

文章排行

圖片新聞

-

國慶假期懷柔北部山區的紅葉進入最佳觀賞期 吸引游客前來賞秋景 國慶假期,懷柔北部山區的紅葉進入...

國慶假期懷柔北部山區的紅葉進入最佳觀賞期 吸引游客前來賞秋景 國慶假期,懷柔北部山區的紅葉進入... -

重磅!四川省科創貸款較年初新增620.35億元 同比增長21.22% 記者日前從中國人民銀行成都分行獲...

重磅!四川省科創貸款較年初新增620.35億元 同比增長21.22% 記者日前從中國人民銀行成都分行獲... -

252項“全程網辦”!川渝兩地企業登記檔案實現跨區域互查 8月30日,記者從省大數據中心獲悉...

252項“全程網辦”!川渝兩地企業登記檔案實現跨區域互查 8月30日,記者從省大數據中心獲悉... -

2022年中國國際服務貿易交易會在京舉辦 四川參展企業數量創新高 8月31日至9月5日,主題為服務合作...

2022年中國國際服務貿易交易會在京舉辦 四川參展企業數量創新高 8月31日至9月5日,主題為服務合作...